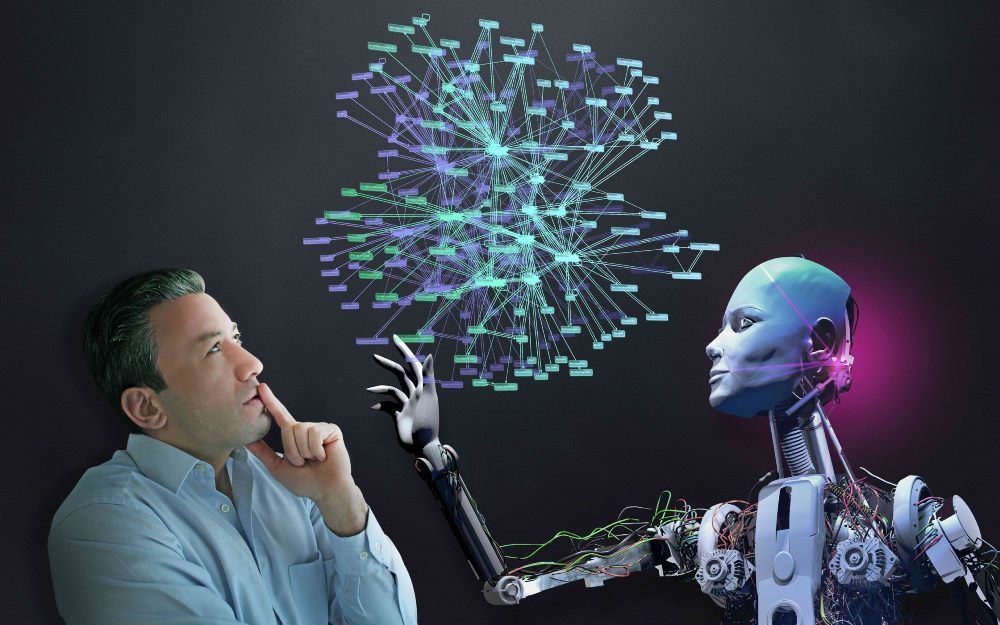

Теперь понятно почему чат-боты строят из себя идиотов и дают заведомо дебильные ответы

Искусственный интеллект подсаживает людей на чувство собственной правоты, чем создает иллюзию гениальности

Наступила эпоха искусственного интеллекта. Люди обращаются к чат-ботам с разными вопросами, иногда даже самыми банальными. Для многих это уже стало обыденной частью жизни, как поиск в Google. Потому что ИИ помогает сэкономить время и утвердиться в собственной правоте. Но вот здесь и кроется опасность.

Как пишет издание IFLScience, даже 5 минут общения с чат-ботом могут создать ощущение, что человек никогда не ошибается. Они слишком хвалебны, особенно боты нового поколения на больших языковых моделях (LLM), среди которых ChatGPT и Claude. Но такие лести ИИ не просто раздражают, а представляют реальную опасность, особенно для уязвимых пользователей. Потому что из-за их "подхалимского поведения" люди часто совершают ошибки и иногда очень серьезные.

Вежливость ИИ – побочный эффект их разработки

Ученые доказали, что склонность чат-ботов к подхалимству возникла как естественный побочный эффект их разработки, все потому, что в приоритете ставилась доброжелательность и вежливость ответов на вопросы от людей. Но эффект перерос в открытое подхалимство. Конечно, из-за этого возникли проблемы, некоторые пользователи даже жаловались на повышение уровня стресса из-за такого общения с ИИ. OpenAI пришлось срочно решать вопросы с ChatGPT.

Австралийский инженер-программист Шон Гоэдеке назвал такое поведение искусственного интеллекта как первую "темную модель", сравнив ее со случаями, когда пользователей сетей легко уговаривают на какую-нибудь рассылку, а затем от нее невозможно отписаться. В этой схеме, по его словам, также все работает из-за подхалимажа. Другой ученый подчеркнул, что постоянное одобрение отрывает людей от реальности, потому что даже в отношениях между двумя любящими людьми не бывает все идеально, иногда нужно говорить жесткую правду, даже если ее неприятно слышать.

То есть чрезмерные лести вредят людям, не дают эволюционировать, чтобы общаться и строить отношения друг с другом. Ведь в социальной жизни не все безоблачно и тогда некоторые люди погружаются в чат-боты, где чувствуют себя уверенными и правыми.

Каков масштаб проблемы с подхалимством ИИ

Ученые провели исследование, в рамках которого сравнили уровень социального подхалимажа в одиннадцати ведущих программах от таких крупных игроков, как OpenAI, Anthropic, Meta и Google. Для этого они проанализировали сообщения реальных людей относительно ситуаций, в которые они попали. Согласно полученным результатам, почти у 51% искусственный интеллект вел себя некорректно, прибегая к подобострастию вместо правдивых ответов. Такое социальное подхалимство влияло на мысли и поведенческие намерения участников диалога.

Люди, которые взаимодействовали с подобострастными ботами, чаще считали себя правыми, несмотря на реальное положение дел, а также впоследствии они стали воспринимать только такие ответы за полезные. Но ученые подчеркнули, что людям для развития критического мышления иногда нужна жесткая и справедливая критика. Интересным фактом стало то, что скептицизм по поводу ответов, сгенерированных ИИ, не защищает людей от лести.

По мнению авторов, подхалимство должно быть одним из факторов, которые должны учитывать политики и разработчики, пытаясь понять, какую роль эта технология будет продолжать играть в нашем обществе.

ЧИТАЙТЕ ТАКЖЕ:

- Бывает и такое: что есть чтобы на два года сделать свой мозг моложе

- В Украине появился сервис для поиска работы на основе искусственного интеллекта – что он умеет

- Искусственный интеллект уже обрабатывает половину всех запросов в Дие: Михаил Федоров

- Тот, кто ест одно и то же, абсолютно прав

- Фанаты кето-диеты столкнулись с приятной побочкой – и речь не о похудении