Війна в Україні

СУМАРНІ ОРІЄНТОВНІ ВТРАТИ ПРОТИВНИКА НА 1566 ДЕНЬ.

Володимир Зеленський – у листі до Путіна:

"Ми перенесли війну на вашу територію, і ви б не впорались із цим без допомоги Північної Кореї. Ви перший правитель Росії, який змушений був звертатись по допомогу у Пхеньян. І сьогодні ви повністю залежите від Китаю – теж вперше в історії Росії."

МУАЯД - Твій яд

Зараз слухають і кайфують - прем'єра кліпу

У кліпі вперше разом із Муаядом з’являються музиканти, а особливої символіки образу артиста додає нагорода переможця шоу «Співають всі!», яку він уперше демонструє публічно саме в цій відеороботі.

ТОП-7 КРАЇН СВІТУ З НАЙБІЛЬШОЮ КІЛЬКІСТЮ БІЖЕНЦІВ З УКРАЇНИ

з офіційним статусом захисту, у тисячах людей, за даними Google

Курс валют на сьогодні

Що слухає Україна

10 найпопулярніших пісень за даними Apple Music

Ціни на пальне у мережевих АЗС України

ТОП-5 ПОЛІТИКІВ УКРАЇНИ З НАЙВИЩИМ РЕЙТИНГОМ

SOCIS - березень 2026

ТОП-7 найдорожчих компаній світу

за версією Brand Finance та Interbrand

Актуальний курс кріптовалют

Як Ігор Рець вижив на стежці ухилянтів із Закарпаття в Румунію

Кореспондент Інформатора забрався на високогір'я Карпат і прожив тиждень у притулку для туристів, щоби взяти інтерв'ю у ухилянтів; на шляху він зустрів прикордонників, військкомів із Хуста, а також численні порушення закону

ТОП-10 найпотужніших економік світу

За даними Світового банку

У США з'явився Інститут-консорціум з безпеки штучного інтелекту: чим він займатиметься

Інститут з'явився після указу Джо Байдена про штучний інтелект

У Сполучених Штатах Америки створили Інститут-консорціум із безпеки штучного інтелекту (ШІ), який об'єднав понад 200 провідних технологічних компаній, у тому числі OpenAI, Google, Mastercard та Visa. Цей консорціум утворює найбільшу групу з тестування та оцінки, фокусуючись на створенні основ для "нової науки про вимірювання в галузі безпеки ШІ".

Про це повідомляє Reuters. Видання пише, що міністр торгівлі США Джина Раймондо оголосила про створення Американського інституту з безпеки інтелектуальних систем (AISIC). В нього увійдуть провідні компанії, зокрема OpenAI, Google, Anthropic, Microsoft, Meta Platforms, Apple, Amazon.com, Nvidia, Palantir, Intel, JPMorgan Chase та Bank of America.

Також уряд США визначив важливу роль у встановленні стандартів та розробці необхідних інструментів для пом'якшення ризиків та максимального використання потенціалу штучного інтелекту. До об'єднання також приєдналися такі гіганти, як BP, Cisco Systems, IBM, Hewlett Packard, Northop Grumman, Mastercard, Qualcomm, Visa, а також великі наукові та урядові установи.

Групі доручили роботу над пріоритетними завданнями, зазначеними в указі президента США Джо Байдена, серед яких розробка керівних принципів, оцінка можливостей, управління ризиками, безпека та захист інтелектуальних систем, а також маркування контенту. Такий консорціум є кроком у напрямку створення стандартів інтелектуальної безпеки та забезпечення контролю за розвитком штучного інтелекту.

Указ Байдена щодо ШІ

З0 жовтня 2023 року президент США Джо Байден видав указ з метою зниження ризиків, пов'язаних зі штучним інтелектом. Згідно з цим документом, розробники систем ШІ зобов'язані повідомляти результати випробувань безпеки уряду США перед оприлюдненням.

Указ має вісім основних цілей:

- Створення нових стандартів безпеки та захисту штучного інтелекту.

- Захист конфіденційності даних.

- Підтримка рівності та громадянських прав.

- Захист споживачів, пацієнтів і студентів.

- Підтримка працівників у сфері штучного інтелекту.

- Сприяння інноваціям та конкуренції.

- Продовження лідерства США в галузі технологій штучного інтелекту.

- Забезпечення відповідального та ефективного використання штучного інтелекту урядом.

Також у документі вказується на необхідність встановлення стандартів для такого тестування та розгляду різних ризиків, включаючи хімічні, біологічні, радіологічні, ядерні та кібербезпекові. Реакція на такий наказ була неоднозначною серед промислових та торгових груп.

Дональд Трамп є "людиною-хаосом" і класичним політичним флюгером: чи є його участь у виборах в США невідворотною, що зможе завадити йому перемогти й чого від усього цього чекати Україні, міркує політтехнолог Борис Тізенгаузен.

Підписуйтесь на наш Telegram-канал, щоб не пропустити важливих новин. За новинами в режимі онлайн прямо в месенджері слідкуйте на нашому Telegram-каналі Інформатор Live. Підписатися на канал у Viber можна тут.

ЧИТАЙТЕ ТАКОЖ:

Останні новини

Настав час відмовитися від чистого харчування - є дуже вагомий привід

Дитина подала позов до власної матері - Верховний суд підтримав рішення про позбавлення батьківських прав

Антон Вельбой не їсть цю улюблену дідову страву, бо треба пити горілку

Депутати Угорщини проголосували за зниження своїх зарплат – не дорахуються майже 40% окладів

Заряд енергії та тепла від Венери з Юпітером – гороскоп на сьогодні, 9 червня

Зеленський поговорив телефоном з посланцями Трампа – Axios

Apple представила оновлену Siri AI – нові функції, інтеграція Gemini та власний застосунок

У Дніпрі двоє чоловіків загинули внаслідок вибуху боєприпасу – на місці працює поліція

Черв'як завдовжки 9 см у шиї - на Волині підтвердили випадок дирофіляріозу від укусу комара

Більшість українців підтримають перемир'я з РФ лише з Європейським щитом на фронті - опитування КМІС

Після смертельного ДТП в Києві, яке вчинив пастор, Свириденко заговорила про посилення відповідальності за порушення ПДР

Покупки на AliExpress і Temu без змін: податок на посилки з-за кордону цього року не запровадять - депутатка Забуранна

Популярне

Дитина подала позов до власної матері - Верховний суд підтримав рішення про позбавлення батьківських прав

Неповнолітня з Кривого Рогу домоглася позбавлення матері батьківських прав через домашнє насильство та заборону отримати паспортДепутати Угорщини проголосували за зниження своїх зарплат – не дорахуються майже 40% окладів

Угорські законодавці підтримали ініціативу партії "Тиса"

Заряд енергії та тепла від Венери з Юпітером – гороскоп на сьогодні, 9 червня

Теплий вплив зорь додасть щедрості, комфорту й відчуття, що все йде як треба, вказують астрологи

Зеленський поговорив телефоном з посланцями Трампа – Axios

Президент України провів телефонну розмову з Віткоффом і Кушнером під час технічної посадки в аеропорту КишиневаУ Дніпрі двоє чоловіків загинули внаслідок вибуху боєприпасу – на місці працює поліція

Смертельний інцидент стався у Новокодацькому районі ДніпраЖурналіст Інформатора

Гроші в хату. 30 тисяч нових клієнтів-ВПО почали тиснути на ринок нерухомості

Colin's під загрозою виходу з України - слідом за Reebok, Koton та SuperStep

SkyUp почала скорочувати рейси та звільняти персонал - українські авіакомпанії повідомляють про системну кризу

Добрі новини

Дніпровський кондитер Дмитро Никифоренко приготував торт у вигляді Bentley

"Останнім часом": у Дніпрі на Воскресенській намалювали мурал з голубом та годинником

Дотисли! Живчик залишає стару етикетку, але є нюанс

Бренд "Живчик" оголосив, що випускатиме напій одночасно у двох варіантах оформлення - класичному та сучасномуУряд ухвалив важливі рішення щодо житла для ВПО

Компенсації за проживання переселенців подовжено з 60 до 90 днів, спрощено підтвердження пошкоджень та відкрито нові дані в кабінеті єВідновлення

Все через ОПЕК - експерти радують водіїв прогнозом цін на АЗС

Рішення картелю збільшити видобуток та деескалація навколо Ірану відкривають шлях до здешевшання бензину та дизелю на 4-5 грн/лВійськовий оглядач

У Санкт-Петербурзі спалахнув завод, що виробляє ракетні установки для армії РФ - відео

У окупованому Донецьку працюють лише дві АЗС - водії стоять у чергах, а бензин крадуть з баків

Росіяни тікають з Кінбурнської коси - Сергій Братчук пояснив, чому Україні важливо виграти у боротьбі логістик

Новини столиці

Передав метадон обвинуваченому просто в суді — справу скерували до суду

Отакої - київський пивний магазин прилаштував на службу хвостовик від авіабомби

Машини серед дітей та пішоходів - у Голосіївському парку знову скандал

Епоха Колиби завершилася – на Березняках з’явиться ще одна GAGA

Водій Mercedes, який убив чотирьох у київському переході, підробляв у таксі - у салоні була пасажирка

Політичний оглядач

Депутатка Марченко не прийшла на апеляцію - ВАКС постановив примусово доставити її до суду

САП поставила крапку у справі Князєва - тюремний термін і свідчення на спільників

Росія вдарила по чотирьох районах Дніпропетровщини – є загиблий і десятеро поранених, пошкоджені будинки, підприємства і банк

Економіка та фінанси: останні новини

Дитина подала позов до власної матері - Верховний суд підтримав рішення про позбавлення батьківських прав

Дотисли! Живчик залишає стару етикетку, але є нюанс

Нічого святого - шахраї створили фейкову Дію

Податкова служба похвалилась цифровізацією - нардеп Федієнко вказав на небезпеку для бізнесу

"Масові керівники" бізнесу та мільярдна виручка: аналіз YouControl

Кореспондент проєкту "Гроші"

Дитина подала позов до власної матері - Верховний суд підтримав рішення про позбавлення батьківських прав

На Львівщині судитимуть соціальну службовицю через загибель 2-річного хлопчика

Вже зрозуміло, яким буде уряд Вірменії - Пашинян його сформує сам, попри тиск Путіна

Новини шоу-бізнеса

Зірку 90-х ошукали в Києві - Досі приходять відписки щодо вкрадених коштів

Співачка Карина Плай втрапила у квартирну аферу в столиці

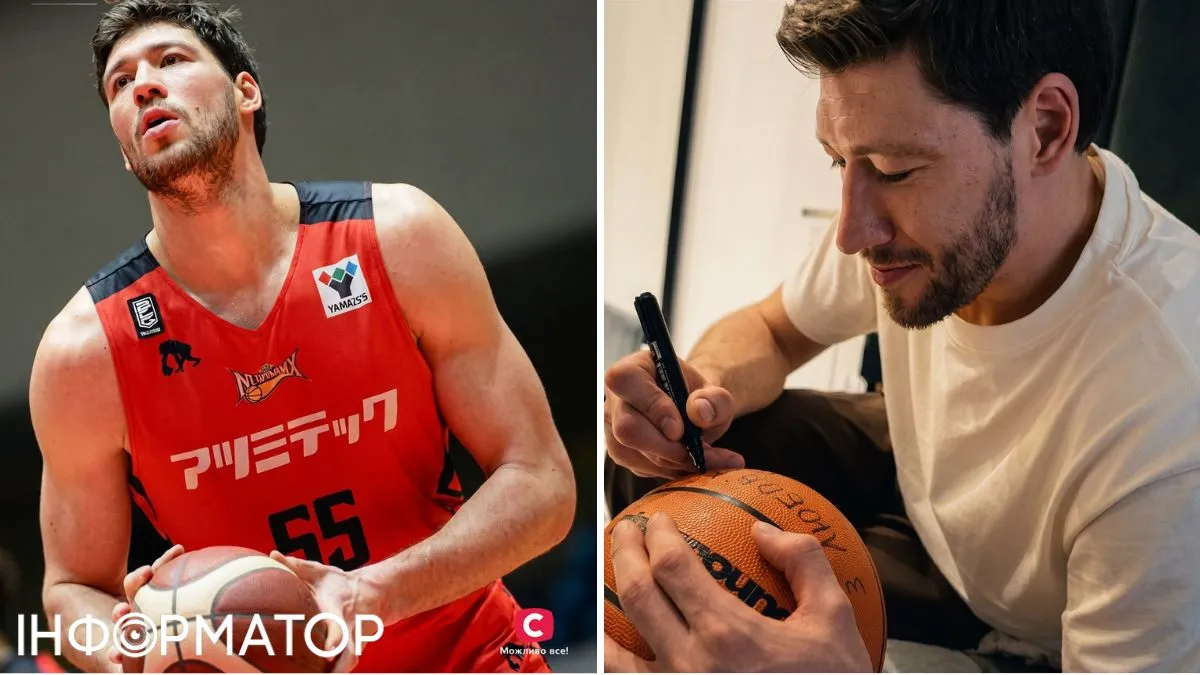

Все почалося з Донецьку - Холостяк В'ячеслав Кравцов пояснив свій поклик до Росії

Кравцов грав за московський баскетбольний клуб ЦСКА, що потім визнав помилкою

Анну Кошмал жорстко принизив відомий актор: Я коли бачу цю людину, мене аж дьоргає

Акторка пережила дуже негативний досвід кастингу, з яким більше ніде не стикалася

Степан Бандера зіпсував особисте життя Васі Харізмі, і це не жарт

Комік призначив побачення дівчині, але воно зірвалося з найнесподіванішої причини

На популярному українському молодіжному серіалі актор поставив хрест - Продовження не чекайте

До розчарування кінофанів: актор Ярослав Шахторін розкрив долю серіалу НовенькаЕкономічний оглядач Інформатора

Свириденко, Соболев, Гетманцев - розкрито лобістів бізнесу, з якими зустрічаються топпосадовці

1,3 млн грн незрозумілих доходів нардепа Железняка не вразили НАЗК - перевіряти його декларацію і спосіб життя не планують

Частину будинку Олени Блаватської у Дніпрі повернули громаді - суд визнав приватизацію незаконною

В Укрзалізниці дали поради пасажирам, які не можуть купити квиток на потрібний потяг

Митник на Львівщині "не помітив" контрабанду техніки Apple, Xiaomi та інших брендів на 66 млн грн - суд обрав суворе покарання

Про життя

Настав час відмовитися від чистого харчування - є дуже вагомий привід

Антон Вельбой не їсть цю улюблену дідову страву, бо треба пити горілку

Продукти проти спалаху на Сонці - що їсти під час магнітної бурі

Грецький йогурт проти яєць - що краще для схуднення

Помилка любителів яловичого фаршу – завжди додавайте до нього дрібку білого порошку

Кореспондент проєкту "Про життя"

Депутати Угорщини проголосували за зниження своїх зарплат – не дорахуються майже 40% окладів

Зеленський поговорив телефоном з посланцями Трампа – Axios

У Дніпрі двоє чоловіків загинули внаслідок вибуху боєприпасу – на місці працює поліція

Новини Дніпра