Війна в Україні

СУМАРНІ ОРІЄНТОВНІ ВТРАТИ ПРОТИВНИКА НА 1566 ДЕНЬ.

Володимир Зеленський – у листі до Путіна:

"Ми перенесли війну на вашу територію, і ви б не впорались із цим без допомоги Північної Кореї. Ви перший правитель Росії, який змушений був звертатись по допомогу у Пхеньян. І сьогодні ви повністю залежите від Китаю – теж вперше в історії Росії."

МУАЯД - Твій яд

Зараз слухають і кайфують - прем'єра кліпу

У кліпі вперше разом із Муаядом з’являються музиканти, а особливої символіки образу артиста додає нагорода переможця шоу «Співають всі!», яку він уперше демонструє публічно саме в цій відеороботі.

ТОП-7 КРАЇН СВІТУ З НАЙБІЛЬШОЮ КІЛЬКІСТЮ БІЖЕНЦІВ З УКРАЇНИ

з офіційним статусом захисту, у тисячах людей, за даними Google

Курс валют на сьогодні

Що слухає Україна

10 найпопулярніших пісень за даними Apple Music

Ціни на пальне у мережевих АЗС України

ТОП-5 ПОЛІТИКІВ УКРАЇНИ З НАЙВИЩИМ РЕЙТИНГОМ

SOCIS - березень 2026

ТОП-7 найдорожчих компаній світу

за версією Brand Finance та Interbrand

Актуальний курс кріптовалют

Як Ігор Рець вижив на стежці ухилянтів із Закарпаття в Румунію

Кореспондент Інформатора забрався на високогір'я Карпат і прожив тиждень у притулку для туристів, щоби взяти інтерв'ю у ухилянтів; на шляху він зустрів прикордонників, військкомів із Хуста, а також численні порушення закону

ТОП-10 найпотужніших економік світу

За даними Світового банку

Mastercard впроваджує ШІ для виявлення підозрілих транзакцій

Mastercard інвестувала понад $7 млрд у розвиток кібербезпеки та штучного інтелекту

Корпорація Mastercard розробила новітню модель генеративного штучного інтелекту Decision Intelligence Pro. Його метою є підвищення ефективності у відстеженні шахрайських транзакцій серед тисяч банків у своїй мережі. Технологію запатентували та незабаром будуть використовувати.

Про це повідомляє CNBC. За інформацією видання, технологію розробили команди корпорації з кібербезпеки.

Відомо, що Decision Intelligence Pro є рекурентна нейронна мережа, що дозволяє аналізувати підозрілі транзакції в режимі реального часу. Вона буде допомагати банкам розрізняти законні операції від шахрайських.

Президент бізнес-підрозділу Mastercard з кібербезпеки та розвідки Аджай Бхалла заявив, що новий алгоритм Mastercard навчається на об'ємній базі даних, що містить інформацію про приблизно 125 млрд транзакцій. Усі вони щорічно проходять через мережу компанії. Завдяки цьому, технологія здатна підвищити точність виявлення шахрайства в середньому на 20%, а в деяких випадках цей показник може зрости до 300%.

Попередньо, за останні п'ять років Mastercard інвестувала понад $7 млрд у розвиток кібербезпеки та штучного інтелекту. Тим самим у компанії заявляють про до захисту фінансових операцій та забезпечення безпеки для банків та їх клієнтів в глобальному масштабі.

Ризики від генеративного штучного інтелекту

Найпотужніший GPT-4, який навчився брехати керівництву, коли навчився торгувати на біржі, може стати інструментом допомоги людям у створенні біологічної зброї. Хоча ризик є невеликим, відкриття є відправною точкою для продовження досліджень і професійного обговорення проблеми. Такі результати досліджень були виявлені провідними спеціалістами OpenAI.

Перші тести, які компанія провела для розуміння та запобігання можливій "катастрофічній" шкоді від своєї технології, показують, що GPT-4 може представляти "щонайбільше" невеликий ризик у створенні біологічних загроз. Зокрема, в статті зазначається, що програма може полегшити завдання зловмисникам у розробці біологічної зброї, використовуючи чатботи для пошуку інформації про планування атак.

Підписуйтесь на наш Telegram-канал, щоб не пропустити важливих новин. За новинами в режимі онлайн прямо в месенджері слідкуйте на нашому Telegram-каналі Інформатор Live. Підписатися на канал у Viber можна тут.

ЧИТАЙТЕ ТАКОЖ:

Останні новини

Зустрінемось біля Самсона - на Поділ повертається ретро-трамвай

Шахраї перехопили контроль над карткою lifcell і взяли понад 17 тис. грн кредиту - що вирішив суд

Справи кепські. Окупанти пишуть про другий удар по мосту у Чонгарі після нічної атаки БПЛА

Цифри вражають - рейтинг зарплат керівництва уряду у травні 2026

Прокурора МКС Каріма Хана, який виписав ордер на арешт Путіна, відсторонили від посади - отримав важкі звинувачення

З 1 липня АЗС в Україні змінять маркування пального - з'являться нові назви E5, E10 та B7

Майже 20 атак за ніч - на Дніпропетровщині є поранені та масштабні руйнування

На будмайданчик метро на Виноградар привезли диво-техніку - робитиме зливостоки

Христина Соловій має компенсувати збитки фермеру - докази є на фото

Суд стягнув з Укрпошти 18 тисяч гривень за втрачену міжнародну посилку до Великої Британії

Грушовая горить вдруге - радник міністра оборони Стерненко

Взяв кредит в ОТП банку, щоб скупитися в Епіцентрі і забув розрахуватися - суд примусив виплатити вдвічі більше, ніж сам борг

Популярне

З 1 липня АЗС в Україні змінять маркування пального - з'являться нові назви E5, E10 та B7

З 1 липня на українських заправках з'являться нові позначення бензину та дизелю - що означають E5, E10 і B7 та чи зростуть ціниМайже 20 атак за ніч - на Дніпропетровщині є поранені та масштабні руйнування

Вночі 9 червня ворог атакував три райони Дніпропетровщини близько 20 разів: пошкоджено будинки, аптеку, кафе та автівки, троє людей постраждали

Христина Соловій має компенсувати збитки фермеру - докази є на фото

У відповідь співачка назвала коментаторів трутнями

Грушовая горить вдруге - радник міністра оборони Стерненко

Нафтовий гігант під Новоросійськом знову палає після атаки дронівЗапоріжжя під шквалом ударів: двоє загиблих, десятки поранених

Окупанти атакували 46 населених пунктів регіону: 605 безпілотників, 28 авіаударів та 246 артобстрілів. Двоє мирних жителів загинулиЖурналіст Інформатора

Гроші в хату. 30 тисяч нових клієнтів-ВПО почали тиснути на ринок нерухомості

Colin's під загрозою виходу з України - слідом за Reebok, Koton та SuperStep

SkyUp почала скорочувати рейси та звільняти персонал - українські авіакомпанії повідомляють про системну кризу

Добрі новини

З 1 липня АЗС в Україні змінять маркування пального - з'являться нові назви E5, E10 та B7

З 1 липня на українських заправках з'являться нові позначення бензину та дизелю - що означають E5, E10 і B7 та чи зростуть ціниДніпровський кондитер Дмитро Никифоренко приготував торт у вигляді Bentley

"Останнім часом": у Дніпрі на Воскресенській намалювали мурал з голубом та годинником

Дотисли! Живчик залишає стару етикетку, але є нюанс

Бренд "Живчик" оголосив, що випускатиме напій одночасно у двох варіантах оформлення - класичному та сучасному

Уряд ухвалив важливі рішення щодо житла для ВПО

Компенсації за проживання переселенців подовжено з 60 до 90 днів, спрощено підтвердження пошкоджень та відкрито нові дані в кабінеті єВідновленняНовини столиці

Зустрінемось біля Самсона - на Поділ повертається ретро-трамвай

На будмайданчик метро на Виноградар привезли диво-техніку - робитиме зливостоки

Під Бучею відкрили байкерський Сільпо - стиль між стімпанком та індустріальним

Передав метадон обвинуваченому просто в суді — справу скерували до суду

Отакої - київський пивний магазин прилаштував на службу хвостовик від авіабомби

Політичний оглядач

Депутатка Марченко не прийшла на апеляцію - ВАКС постановив примусово доставити її до суду

САП поставила крапку у справі Князєва - тюремний термін і свідчення на спільників

Росія вдарила по чотирьох районах Дніпропетровщини – є загиблий і десятеро поранених, пошкоджені будинки, підприємства і банк

Економіка та фінанси: останні новини

Шахраї перехопили контроль над карткою lifcell і взяли понад 17 тис. грн кредиту - що вирішив суд

Суд стягнув з Укрпошти 18 тисяч гривень за втрачену міжнародну посилку до Великої Британії

Взяв кредит в ОТП банку, щоб скупитися в Епіцентрі і забув розрахуватися - суд примусив виплатити вдвічі більше, ніж сам борг

Кінець дешевим посилкам і електромобілям та проблеми брокерам - адвокатка розповіла про новий Митний кодекс України

Втрачені документи на житло до 2013 року - Мін'юст пояснив, як відновити право власності

Кореспондент проєкту "Гроші"

Суд стягнув з Укрпошти 18 тисяч гривень за втрачену міжнародну посилку до Великої Британії

Взяв кредит в ОТП банку, щоб скупитися в Епіцентрі і забув розрахуватися - суд примусив виплатити вдвічі більше, ніж сам борг

Дитина подала позов до власної матері - Верховний суд підтримав рішення про позбавлення батьківських прав

Новини шоу-бізнеса

Христина Соловій має компенсувати збитки фермеру - докази є на фото

У відповідь співачка назвала коментаторів трутнями

Арсен Мірзоян побився з військовими - Та це нормально

Мірзоян поскаржився, що зараз "хлопець хлопцю не може спокійно морду набить"

Зірку 90-х ошукали в Києві - Досі приходять відписки щодо вкрадених коштів

Співачка Карина Плай втрапила у квартирну аферу в столиці

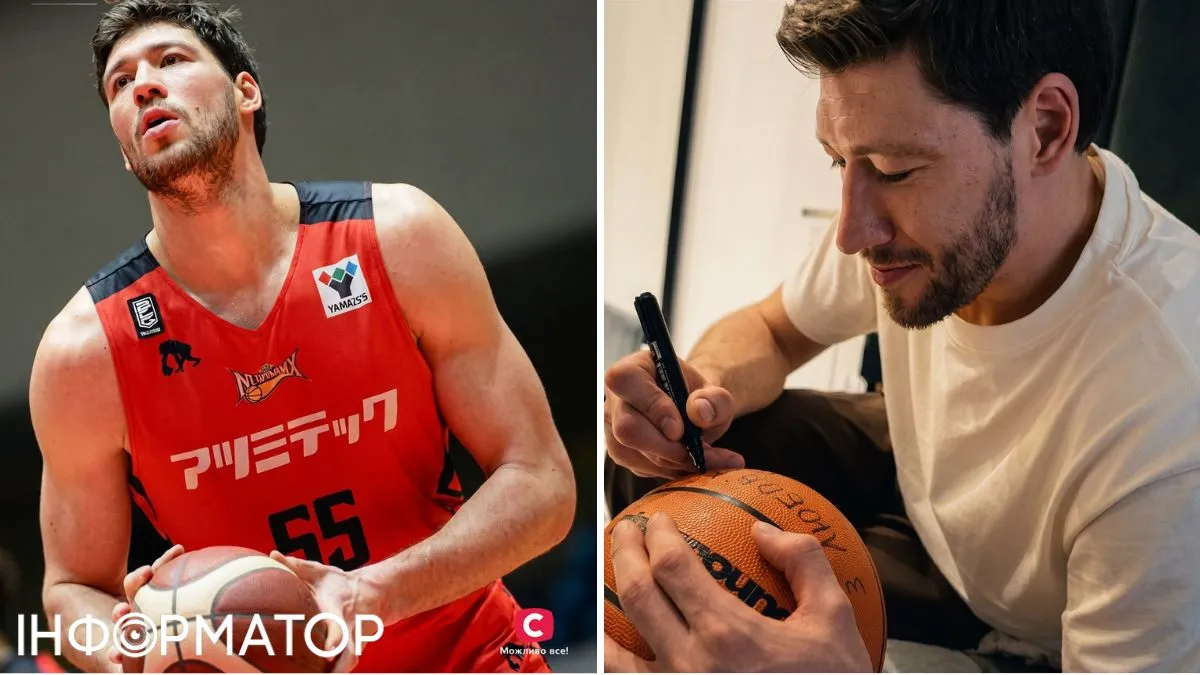

Все почалося з Донецьку - Холостяк В'ячеслав Кравцов пояснив свій поклик до Росії

Кравцов грав за московський баскетбольний клуб ЦСКА, що потім визнав помилкою

Анну Кошмал жорстко принизив відомий актор: Я коли бачу цю людину, мене аж дьоргає

Акторка пережила дуже негативний досвід кастингу, з яким більше ніде не стикаласяЕкономічний оглядач Інформатора

Кінець дешевим посилкам і електромобілям та проблеми брокерам - адвокатка розповіла про новий Митний кодекс України

Свириденко, Соболев, Гетманцев - розкрито лобістів бізнесу, з якими зустрічаються топпосадовці

1,3 млн грн незрозумілих доходів нардепа Железняка не вразили НАЗК - перевіряти його декларацію і спосіб життя не планують

Частину будинку Олени Блаватської у Дніпрі повернули громаді - суд визнав приватизацію незаконною

В Укрзалізниці дали поради пасажирам, які не можуть купити квиток на потрібний потяг

Про життя

На вигляд натуральна дурість – 10 несподіваних ознак високого інтелекту

Настав час відмовитися від чистого харчування - є дуже вагомий привід

Антон Вельбой не їсть цю улюблену дідову страву, бо треба пити горілку

Продукти проти спалаху на Сонці - що їсти під час магнітної бурі

Грецький йогурт проти яєць - що краще для схуднення

Кореспондент проєкту "Про життя"

Депутати Угорщини проголосували за зниження своїх зарплат – не дорахуються майже 40% окладів

Зеленський поговорив телефоном з посланцями Трампа – Axios

Apple представила оновлену Siri AI – нові функції, інтеграція Gemini та власний застосунок

Новини Дніпра