Незнання, які не дають вам нормально поговорити з ChatGPT

Чат-боти з ШІ навчаються за допомогою людини, але їхня інформація швидко старіє

Чат-боти на основі штучного інтелекту міцно увійшли в життя мільйонів людей. Їх використовують як консультантів, лікарів, фітнес-тренерів чи просто друзів. Люди ставлять безліч питань, від робочих до інтимних. Але, щоб відповісти, чат-ботам не завжди вистачає власних даних і тоді вони використовують інтернет-пошук.

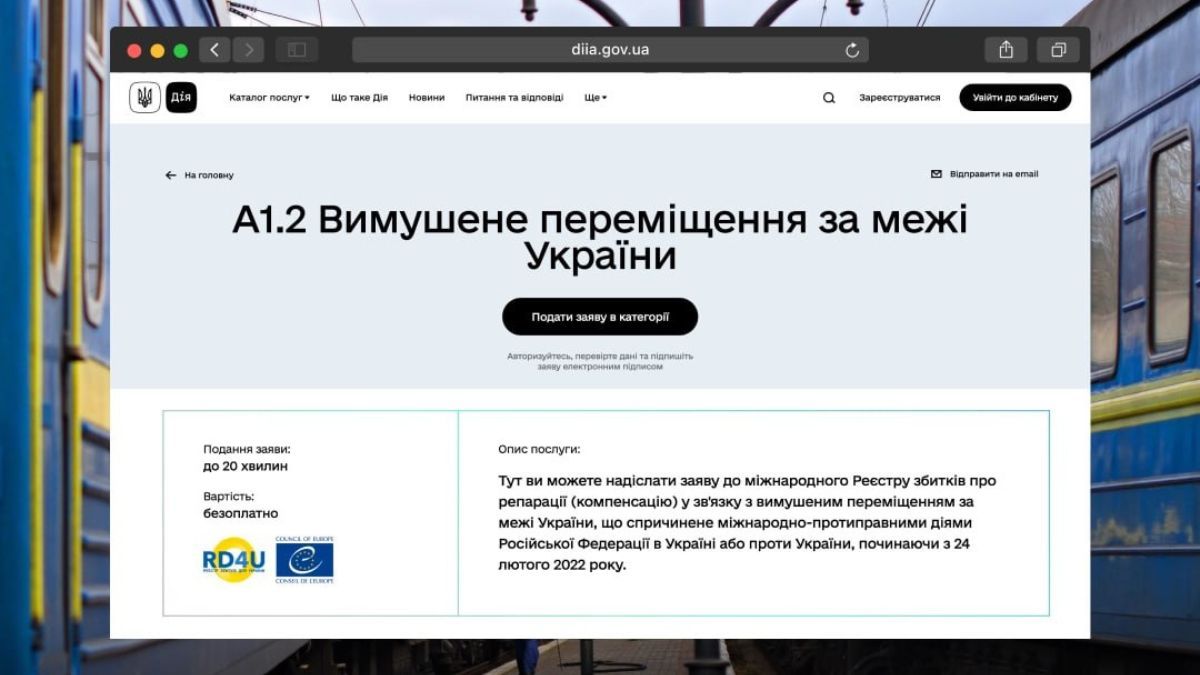

Як пише видання ScienceAlert, до інтернет-пошуку під час відповіді на запитання, наприклад, вдається ChatGPT. Це стосується подій, які стались після червня 2024 року. Загалом, чат-боти працюють за певним алгоритмом і, щоб правильно з ними спілкуватись та розуміти, як вони взагалі працюють, треба знати всього 5 речей. Тоді відповіді на запитання будуть лаконічними та повними.

Чат-боти навчаються з допомогою людини

Навчання чат-ботів на основі ШІ проходить у кілька етапів. Спочатку моделі вчать передбачати наступне слово у текстах, а потім розвивати загальне розуміння мови, фактів та міркувань. Люди-аннотатори допомагають направляти чат-боти до більш безпечних і корисних відповідей. Щоб вони, наприклад, не відповідали на питання щодо створення вибухівки або інших провокативних.

Після таких узгоджень та вирівнювань чат-боти на основі штучного інтелекту дають відповіді обтічні і радять звернутись за допомогою до фахівців або сертифікованих освітніх джерел. Якби цього не було, то вони були б непередбачувані та могли поширювати дезінформацію або шкідливий контент. Тобто роль людини у навчанні та формуванні поведінки ШІ є вирішальною.

Чат-боти вчаться не за допомогою слів і швидко старіють

На відміну від людей, які вивчають мову через слова, чат-боти з ШІ роблять це за допомогою так званих токенів. Ці одиниці можуть бути словами, підсловами або незрозумілими серіями символів. Словники сучасних чат-ботів складаються з 50-100 тисяч токенів.

Чат-боти з ШІ не оновлюються постійно, тому вони можуть відчувати труднощі з поясненням певних подій, які стались нещодавно. Поточна версія ChatGPT має інформацію до червня 2024 року. Якщо приходить запит на пояснення події після цієї дати, то система вдається до інтернет-пошуку, проводить аналіз, а потім дає відповідь.

Чат-боти схильні до галюцинацій, але здатні міркувати

Чат-боти з ШІ іноді генерують помилкові або безглузді заяви, бо не перевіряють факти. А все тому, що вони передбачають текст на основі шаблонів і не розуміють реального світу. Ці недоліки у науковому світі називають "галюцинаціями" ШІ. Над їх мінімізацією працюють фахівці, але повністю усунути не можуть. Тому користувачі мають розглядати інформацію, згенеровану ШІ, як відправну точку, а не як істину.

Попри "галюцинації", чат-боти з ШІ здатні міркувати і будувати ланцюжок думок. Для вирішення складних проблем, вони використовують логічно пов'язані проміжні кроки. Наприклад, для вирішення математичних завдань ChatGPT використовує вбудований калькулятор. Саме він дозволяє виконувати точну арифметику і робить це покроково, з розумінням, що спочатку виконується множення чи ділення, а тільки потім додавання чи віднімання. Цей гібридний підхід, що поєднує внутрішні міркування з калькулятором, допомагає підвищити надійність чат-бота у складних завданнях.

ЧИТАЙТЕ ТАКОЖ:

- Відчепіться вже від ШІ: Укрпошта пропонує власну абетку на марках

- Ми недооцінили штучний інтелект: ексгендиректор Intel розповів про прорахунки компанії

- Шахраї підробляють сайти інтернет-магазинів, щоб вкрасти ваші гроші: Кіберполіція пояснює, як захиститися

- Манікюр так уже ніхто не робить: гель-лаку знайшли заміну

- Головна помилка під час вибору сонцезахисного крему - не розуміють дві цифри на етикетці