Мошенники научились клонировать голос с помощью Grok: Киберполиция дала советы по безопасности

Киберполиция советует подумайте дважды, прежде чем выкладывать длинные видео или стороз со своим чистым голосом в открытые профили, ведь это - идеальный материал для обучения нейросетям

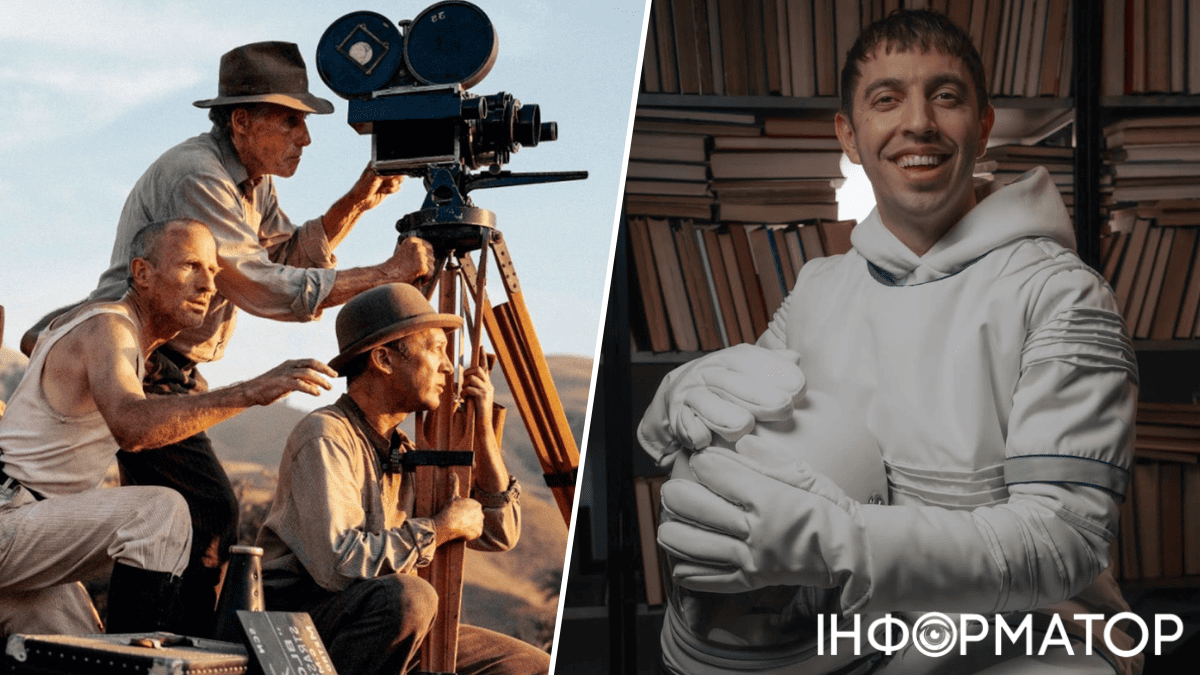

Компания Илона Маска xAI запускает Custom Voices для своего чат-бота Grok. Теперь искусственный интеллект может мгновенно клонировать любой голос на основе короткой аудиозаписи. Это может стать опасным оружием в руках мошенников. Киберполиция 4 мая дает советы, как не стать жертвой дипфейков.

Киберполиция советует ввести следующие меры безопасности:

- Секретное слово. Договоритесь с близкими о секретном слове, которое знаете только вы. Если вам звонит по телефону «сын» с просьбой срочно перевести деньги – попросите назвать пароль.

- Контрольные вопросы. Если голос кажется похожим, но ситуация подозрительна, спросите, что невозможно найти в соцсетях (например: какого цвета коврик в нашей ванной комнате).

- Запасной канал связи. Получив голосовое сообщение или звонок – положите трубку и сами перезвоните этому человеку на его обычный номер.

- Покой. Мошенники пытаются создать панику и чувство срочности. Итак, выдыхайте и мыслите критически.

"Подумайте дважды, прежде чем выкладывать длинные видео или сторозий со своим чистым голосом в открытые профили. Это - идеальный материал для обучения нейросетям. Помните: Технологии развиваются быстрее, чем мы успеваем к ним привыкнуть. Ваша бдительность - лучший фильтр против манипуляций", - пишет Киберполиция.

Как сообщал Информатор, пользователи стали получать фейковые сообщения якобы от службы поддержки Signal. В сообщении утверждается, что на устройстве зафиксирована "подозрительная активность", якобы уже была "несанкционированная атака", злоумышленники пытаются получить доступ к частным чатам. После этого пользователя подталкивают пройти "верификацию" прямо в чате, причем "быстрее" и "за 1 минуту". Ни один мессенджер, включая Signal, не будет писать вам в личные сообщения с требованием "срочно подтвердить аккаунт". Если вас пугают и подгоняют – это почти всегда мошенничество, объясняет Киберполиция.