Война в Украине

СУМАРНІ ОРІЄНТОВНІ ВТРАТИ ПРОТИВНИКА НА 1481 ДЕНЬ.

1279170

+740

Личный состав

11781

+4

Танки

24213

+1

Боевые бронированные машины

38438

+17

Артиллерийские системы

1686

Реактивные системы залпового огня

1332

Системы противовоздушной обороны

435

Самолеты

349

Вертолеты

83513

+110

Автомобильная техника и цистерны с ГСМ

32

+1

Военные корабли и катера

179270

+1984

Беспилотные летательные аппараты

4468

+65

Крылатые ракеты

По данным Генерального штаба ВСУ

BRYKULETS - Планета Любов

Сейчас слушают и кайфуют - премьера клипа

«Планета Любов» – это трек о состоянии, когда любовь становится отдельной реальностью. Когда один человек превращается в мир, день и даже кислород для легких. В этой песне сочетаются одержимость и нежность, цветы с утра и немного безумия ночью, все честно, без фильтров.

Какое место Украина займет на Евровидении

От нашей страны едет певица Leleka голосов

Что слушает Украина

10 самых популярных песен по версии Apple Music

1

Real Love (Echovibe remix)

Echovibe

2

Енкарапіста

Drevo

3

Nobody

Aarne, Toxi$, Big Baby Tape

4

Mafia Style

Trap mafia house

5

Не пʼяна - закохана

Alena Omargalieva

6

Не складається

Max Barskih

7

Купер

Sqwoz Bab

8

Ozon

Nuor Garsas

9

Theclubrock

Benny Bellson

10

Тут і зараз

Nataliia Rusnak

Курс валют на сегодня

Валюта

Покупка

Продажа

usd

44.14

44.14

eur

50.67

50.67

Цены на топливо в сетевых АЗС Украины

А95+

А95

ДП

ГАЗ

74.89

70.49

79.09

44.6

73.13

69.99

77.85

43.69

73.99

70.99

77.99

44.98

-

66.74

71.94

40.36

73.99

70.99

77.99

44.99

71.99

68.99

72.99

40.99

ТОП-5 САМЫХ БОГАТЫХ МЭРОВ - ДАННЫЕ ИЗ ДЕКЛАРАЦИЙ (млн. грн.)

1

Терехов, Харьков

2,000

2

Бондаренко, Черкассы

1,342

3

Кличко, Киев

1,233

4

Андреев, Ужгород

1,182

5

Мрочко, Херсон

1,148

ТОП-7 самых дорогих брендов мира по версии VisualCapitalist

1

![up]()

Apple

$516 млрд.

2

![up]()

Microsoft

$340 млрд.

3

![up]()

Google

$333,4 млрд.

4

![up]()

Amazon

$308,9 млрд.

5

![up]()

Samsung

$99,4 млрд.

6

![up]()

Wal,art

$96,8

7

![up]()

TikTok

$84,2 млрд.

ТОП-5 ПОЛИТИКОВ УКРАИНЫ С НАИВЫСШИМ РЕЙТИНГМ

По опросу SOCIS 21 января 2025 года

1

![up]()

Залужный

36,1%

2

![up]()

Зеленский

24,3%

3

![up]()

Порошенко

9,4%

4

![up]()

Разумков

8,3%

5

![up]()

Тимошенко

6%

Актуальный курс криптовалют

BINANCE COIN (BNB)

659.59

DOGECOIN (DOGE)

0.1

THETA (THETA)

0.18

LITECOIN (LTC)

55.22

BITCOIN (BTC)

71506.1

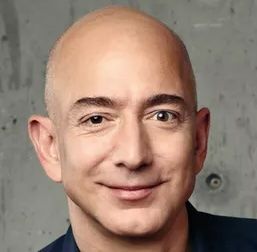

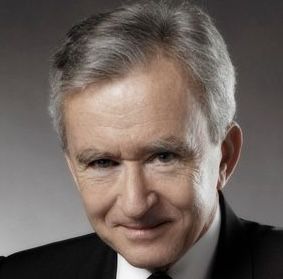

ПЯТЕРКА САМЫХ БОГАТЫХ В МИРЕ

По версии Bloomberg

1

![up]()

Илон Маск

$432 млрд

2

![up]()

Джефф Безос

$239 млрд

3

![up]()

Марк Цукерберг

$207 млрд

4

![up]()

Ларри Элисон

$192 млрд

5

![up]()

Бернар Арно

$176 млрд

Как Игорь Рец выжил на тропе ухилянтов из Закарпатья в Румынию

Корреспондент Информатора забрался на высокогорье Карпат и провел неделю в убежище для туристов, чтобы взять интервью у ухилянтов; на своем пути он встретил пограничников, а также столкнулся с многочисленными нарушениями закона

Путешествие Игоря закончилось в ТЦК и СП Хуста, откуда, как говорят, одна дорога - в учебку, а потом на фронт. Итогом поездки стал подробный отчет о приключениях. Мы публикуем его в нескольких частях

ТОП-10 самых мощных экономик мира

По данным Всемирного банка

1

США

$27 360,935 млрд.

2

Китай

$17 794,782 млрд

3

Германия

$4 456,081 млрд.

4

Япония

$ 4 212,945 млрд.

5

Индия

$3 549,919 млрд.

6

Великобритания

$3 340,032 млрд.

7

Франция

$3 030,904 млрд.

8

Италия

$2 254,851 млрд.

9

Бразилия

$2 173,666 млрд.

10

Канада

$2 140,086 млрд.

Поджег авто ЗСУ

Кому именно спецслужбы РФ через ресурсы по трудоустройству предлагают легкие деньги за преступление против обороны страны: расследование Информатора

Под видом человека, ищущего быстрый заработок, наш корреспондент Игорь Рец пообщался в соцсетях с российскими вербовщиками и сделал выводы, которые могут быть полезны для безопасности ваших детей и друзей

Кулинарный рецепт от Информатора

Игорь Кондратюк расписался в своем бессилии, но ситуацию спасает его бабушка

Игорь Кондратюк рассказал, что совсем не умеет готовить. Разве что сварить макароны и сосиски. Хотя он не считает себя гурманом, потому и эти блюда подойдут для ежедневного обеда или завтрака.

Почему искусственный интеллект не панацея для модераторов Facebook

В последнее время многие компании говорят об искусственном интеллекте и о том, как его можно использовать в социальных сетях для модерации контента. Но мировые эксперты относятся скептически к этому и утверждают - настолько сложной технологии нет и вряд ли она появится в обозримом будущем. Большинство социальных сетей хранят нежелательный контент на своих платформах, используя комбинацию автоматической фильтрации и модераторов. Об этом сообщает Информатор Tech, ссылаясь на The Verge. Недавние исследования показали, что модераторы часто работают в очень стрессовых условиях. Они должны ежедневно просматривать сотни элементов подозрительного контента - от убийства до сексуального насилия - и затем решать, нарушает ли он правила платформы, часто работая по строгому графику и без надлежащего обучения или поддержки. Со временем у модераторов может появиться такая проблема, как предвзятость, поэтому в Facebook так часто утверждают, что внедрение ИИ - это решение всех проблем с нежелательным контентом на платформе. В прошлом году во время выступления перед конгрессом США Марк Цукерберг более 30 раз упомянул о необходимости внедрения ИИ как решение большинства проблем социальных сетей. The Washington Post тогда написали: «Это не решит проблемы Facebook, но решит проблему Цукерберга: заставить кого-то взять на себя ответственность». Насколько важную роль играет ИИ для Facebook и других платформ, и почему сейчас его возможности так ограничены?

Проблемы работы алгоритмов в распознавании контекста в материалах

В настоящее время алгоритмы, использующие ИИ и машинное обучение, безусловно, помогают модерации. Они действуют как системы сортировки, например, передавая подозрительный контент модераторам, и могут отсеивать нежелательный материал самостоятельно. Делается это с помощью визуального распознавания (например, обнаженное тело или оружие). Такой способ часто приводит к тому, что разрешенный контент блокируется. Второй способ - сопоставление контента с индексом запрещенных элементов, что, в первую очередь, требует от людей создания указанного индекса. Последний подход используется, чтобы избавиться от очевидно запрещенного материала, нарушающего права: пропагандистские видеоролики от террористических организаций, материалы о насилии над детьми и материалы, защищенные авторским правом. В каждом случае контент превращается в уникальную строку чисел, которая быстрее обрабатывается. Технология, в целом, надежна, но все же может привести к проблемам. Например, система YouTube Content ID помечает белый шум и пение птиц в роликах, как нарушение авторских прав.

Как далеко мы сможем продвинуть ИИ в нашей жизни

ИИ, как система, очень стремительно развивается. Но смогут ли алгоритмы надежно классифицировать тот или иной вид контента в будущем? Ученые Голдман и Каплан настроены скептически. По словам Голдмана, ИИ станет лучше понимать контекст, но не факт, что он скоро сможет сделать это лучше, чем человек. «ИИ не заменит рецензентов-людей в обозримом будущем», - говорит он. Каплан соглашается и указывает, что, пока люди спорят о том, как классифицировать разные типы материалов, какие шансы есть у машин? «Нет простого решения», - говорит она. «Мы будем продолжать наблюдать за проблемами». Безусловно, технология еще слишком сырая, чтобы классифицировать контент в любом контексте и ситуации, потому как наш мозг устроен гораздо сложнее любого ИИ, который постоянно учиться. Пока что стоит воспринимать эту технологию как помощь модераторам, а не их замену. Но учитывая быстрые темпы развития данной сферы, возможно, что уже через 5-10 лет все будет делать ИИ и различные алгоритмы машинного обучения, по крайней мере с классификацией контента в социальных сетях. Тем временем, ООН рассказала о лидерах в сфере ИИ и о самой популярной области в этой сфере. Напомним, что искусственный интеллект от Google продемонстрировал впечатляющие возможности.Даниил Подгаецкий

Последние новости

Обратные поставки: Россия передает Ирану ударные беспилотники, заявил Зеленский

Махались прямо посреди проспекта возле метро Минская: в Киеве произошла масштабная драка

Должник за границей: когда решение украинского суда можно выполнить в другом государстве, объясняет Минюст.

Почти сотня дронов: Россия ночью запускала беспилотники, украинская ПВО обезвредила угрозы

Довоевались: Израиль на грани исчерпания боеприпасов к противобаллистическим системам ПВО, пишут СМИ

Мужчина при попытке получения денежной помощи потерял из кредитки 30 тысяч гривен, а Ощадбанк дополнительно заставляет его закрыть долг 48 673 гривен – что решил суд

Белгород и Краснодарский край РФ ночью были под масштабным ударом: что удалось поразить

Креативный фишинг: полный список типов мошеннических писем

Верующим повезло - Оксана Гутцайт нашла горячий холодник

Мужчина взял 5 тысяч долларов на РЭБ для ВСУ, но не вернул средства: что решил суд

Какой сегодня, 15 марта, праздник: День борьбы с полицейской жестокостью и защиты прав потребителей

Официально: Формула-1 отменила гран-при Бахрейна и Саудовской Аравии в апреле

Популярные

Должник за границей: когда решение украинского суда можно выполнить в другом государстве, объясняет Минюст.

Анализ практики свидетельствует, что средний срок от направления ходатайства на рассмотрение до принятия компетентным судом решения по существу составляет восемь месяцевКреативный фишинг: полный список типов мошеннических писем

В большинстве случаев сотрудники допускают ошибки, потому что боятся подвести компанию или выглядеть некомпетентными, игнорируя «срочный запрос» руководства или госструктур.

Верующим повезло - Оксана Гутцайт нашла горячий холодник

Блюдо по этому рецепту получается сбалансированное по вкусу и очень ароматное

Какой сегодня, 15 марта, праздник: День борьбы с полицейской жестокостью и защиты прав потребителей

В этот день родились американская актриса Ева Лонгория и украинская журналистка Оксана ГутцайтВиктор, остановись: Ющенко обратился к Орбану из-за его позиции по поводу войны, тот шокировал ответом

Третий президент Украины Виктор Ющенко призвал премьера Венгрии Виктора Орбана вспомнить о европейских ценностях и прекратить, по его словам, подыгрывать агрессору. В ответ венгерский лидер обвинил Украину в государственном терроризме и заявил, что Будапешт не будет оказывать Киеву военную или финансовую помощьВоенный обозреватель

Анна Копытько

Редактор

Страны мира

ЕС продлил санкции против России до сентября: под давлением остаются 2600 человек и организаций

Геополитика

Нетаньяху инициировал переговоры с Зеленским по поводу иранских дронов

Геополитика

Украина показала дипломатам доказательства атаки РФ на нефтепровод Дружба

Хорошие новости

Зажигательные танцы, конкурс косплеев и причудливые костюмы: в Днепре проходил аниме-фестиваль

ПФУ произведет автоматический перерасчет субсидий по тарифам ЖКХ — когда и кого коснутся изменения

Проведение такого перерасчета предусмотрено пунктом 92 Положения о порядке назначения жилищных субсидий, утвержденного постановлением Кабинета министров Украины от 21.10.1995 года № 848 "Об упрощении порядка предоставления населению субсидий для возмещения расходов на оплату жилищно-коммунальных услуг, приобретение сжиженного топлива"Россияне запустили около 70 ракет и сотни дронов: в Воздушных силах сказали, как сработала ПВО

Во время ракетной атаки врага было обезврежено более 90 процентов дронов и почти все запущенные оккупантами ракеты.Поступающие за границей смогут пройти НМТ, но им понадобится дополнительный документ

Поступившие, которые уже получили или в этом году получат полное среднее образование за границей, смогут зарегистрироваться и составить НМТ

Массированная атака России: в Киевской области много погибших и раненых

В Киевской области после массированной атаки российских оккупантов уже четыре человека погибли и по меньшей мере 10 получили раненияПолитический обозреватель

Ярослав Коджушко

Редактор

Политика

Зеленский объяснил, почему переговоры с РФ и США постоянно переносят: там целая Санта-Барбара

Политика

Зеленский встретился с наследным принцем Ирана: говорили лицом к лицу

Политика

В Слуге народу раскрыли, сколько депутатов готовы сложить мандат: цифра шокирует

Новости столицы

В Василькове боевая часть ракеты Х-101 влетела в спальню, а еще одна упала на крышу авто

Покупали виртуальные квартиры: Киевсовет неожиданно разоблачил схему безумных краж в КГГА

Мусор, грязь, хлам и снова мусор: самый трешовый квартал в Киеве нашелся на Виноградаре

От российских обстрелов в Киевской области пострадали пять учебных заведений

Котик Йой: спасенный на фронте котенок нашел дом в Киеве

Корреспондент проекта "Деньги"

Владлена Мачульская

Журналист

Экономика

Мужчина при попытке получения денежной помощи потерял из кредитки 30 тысяч гривен, а Ощадбанк дополнительно заставляет его закрыть долг 48 673 гривен – что решил суд

Экономика

Мужчина взял 5 тысяч долларов на РЭБ для ВСУ, но не вернул средства: что решил суд

Экономика

ПФУ произведет автоматический перерасчет субсидий по тарифам ЖКХ — когда и кого коснутся изменения

Экономика и финансы: последние новости

Мужчина при попытке получения денежной помощи потерял из кредитки 30 тысяч гривен, а Ощадбанк дополнительно заставляет его закрыть долг 48 673 гривен – что решил суд

Креативный фишинг: полный список типов мошеннических писем

Мужчина взял 5 тысяч долларов на РЭБ для ВСУ, но не вернул средства: что решил суд

ПФУ произведет автоматический перерасчет субсидий по тарифам ЖКХ — когда и кого коснутся изменения

Двухлетняя эра дешевой гречки закончилась: обзор цен в супермаркетах

Экономический обозреватель Информатора

Дмитро Чернишов

Редактор

Экономика

Локальный Миндич: прокуратура не дала заплатить лишние 4 миллиона на ремонт дорог в городе Самар на Днепропетровщине

Экономика

Нанять на работу людей из Индии, Бангладеша и других стран в Украину: инструкция от Миграционной службы

Экономика

Адвокат рассказала, как правильно госслужащим заполнять декларацию при увольнении

Экономика

Укрзализныця потратит 15 млн грн на SMS-сообщения: деньги освоит фирма из Киева

Экономика

В Укрпочте ответили Информатору, используют ли они труд лошадей, ослов и лам

Новости шоу-бизнеса

Опасно сексуальная – Румыния вышла за рамки приличия и ее не пускают на Евровидение

Песня румын признана опасной, ведь она о гламуризации сексуального удушения

Оторвало палец, поэтому решил, что с актерством покончено: звезда сериала Ховаючи колишню стал певцом

Актер Артур Логай рассказал, как он начал заниматься музыкой и петь

Умер главный конопатый хулиган советского кино, обижавший Сыроежкина: Ты Сыроушкин или Сыропопкин

В Одессе ушел из жизни украинский актер Василий Скромный. Именно он сыграл рыжеволосого хулигана в Приключениях Электроника, а в жизни был моряком

Звезда Киборгов убил наповал – он советует учиться на Михалкове и Тарковском

Актер Вячеслав Довженко признался, что даже сегодня иногда советует студентам смотреть советское кино

История Гераскевича будет хуже, чем с Усиком: Гарик Корогодский поставил крест на амбициях спортсменов

При этом бизнесмен подчеркнул, что очень хорошо относится к боксеру – слишком хорошоКорреспондент проекта "Звезды"

Николай Милиневский

Журналист

Шоу-Биз

Умер спокойно: у хорошего русского Бориса Гребенщикова в Японии остановилось сердце

Шоу-Биз

Наталья Денисенко вышла с любимым в свет и не выдержала: Оставьте нас в покое

Шоу-Биз

Андрей Хлывнюк поставил диагноз мобилизации: Меня бесит быть попрошайкой

Про жизнь

Верующим повезло - Оксана Гутцайт нашла горячий холодник

Какой сегодня, 15 марта, праздник: День борьбы с полицейской жестокостью и защиты прав потребителей

Вместе теплее и удобнее — семь советов, чтобы спать как младенец

С Черного моря в Украину надвигается неприятный циклон — прогноз погоды на 15 марта

Игорь Кондратюк расписался в своем бессилии, но ситуацию спасает его бабушка

Новости Днепра